Funkce pipeline() je nedílnou součástí knihovny Transformer. Vyžaduje několik vstupů, ve kterých můžeme definovat inferenční úlohu, modely, mechanismus tokenizace atd. Funkce pipeline() se převážně používá k provádění úloh NLP na jednom nebo několika textech. Provádí předběžné zpracování na vstupu a následné zpracování na základě modelu za účelem generování výstupu čitelného člověkem a přesné predikce s maximální přesností.

Tento článek se zabývá následujícími aspekty:

Co je knihovna datové sady Hugging Face?

Knihovna datových sad Hugging Face je API, které obsahuje několik veřejných datových sad a poskytuje snadný způsob, jak je stáhnout. Tuto knihovnu lze importovat a nainstalovat do aplikace pomocí „ pip “příkaz. Pro praktickou ukázku stažení a instalace datových sad knihovny Hugging Face navštivte toto Odkaz na Google Colab. Můžete si stáhnout více datových sad z Hugging Face Dataset Hub.

Další informace o fungování funkce pipeline() naleznete v tomto článku „ Jak využít funkci Pipeline() v transformátorech? “.

Jak aplikovat potrubí na datovou sadu v Hugging Face?

Hugging Face poskytuje několik různých veřejných datových sad, které lze snadno nainstalovat pomocí jednořádkového kódu. V tomto článku uvidíme praktickou ukázku aplikace potrubí na tyto datové sady. Existují dva způsoby, jak lze potrubí implementovat do datové sady.

Metoda 1: Použití iterační metody

Funkci pipeline() lze také iterovat přes datovou sadu a model. Za tímto účelem postupujte podle níže uvedených kroků:

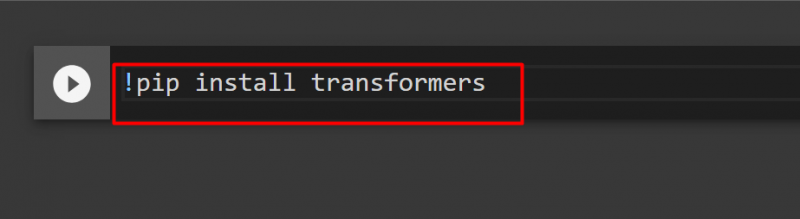

Krok 1: Nainstalujte knihovnu Transformer Library

Chcete-li nainstalovat knihovnu Transformer, zadejte následující příkaz:

!pip instalujte transformátory

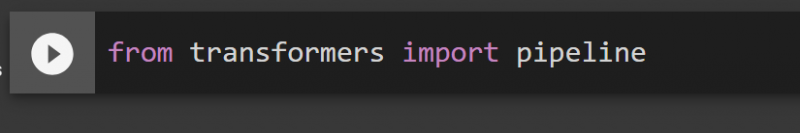

Krok 2: Import potrubí

Můžeme importovat potrubí z knihovny Transformer. Za tímto účelem zadejte následující příkaz:

z transformátorů import potrubí

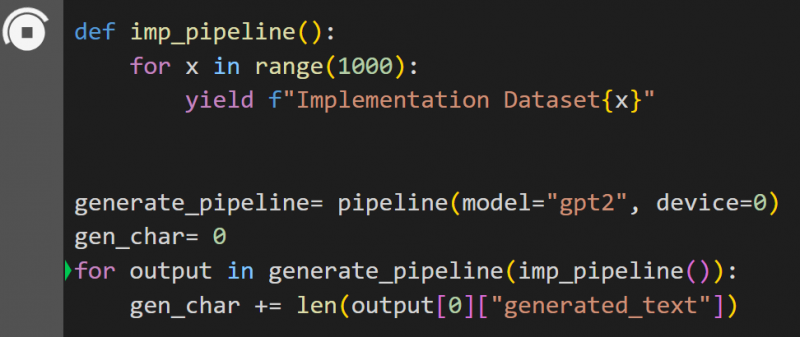

Krok 3: Implementujte potrubí

Zde je funkce pipeline() implementována na modelu „ gpt2 “. Modely si můžete stáhnout z Hub pro model objímání obličeje:

def imp_pipeline():pro x v rozsahu (1000):

výnos f'Implementační datová sada{x}'

create_pipeline= pipeline(model='gpt2', device=0)

gen_char= 0

pro výstup v create_pipeline(imp_pipeline()):

gen_char += len(výstup[0]['generovaný_text'])

V tomto kódu je „ generovat_potrubí ” je proměnná, která obsahuje funkci pipeline() s modelem “ gpt2 “. Když se zavolá pomocí „ imp_pipeline() “, automaticky rozpozná data, která se zvětší o rozsah zadaný na 1000:

To zabere nějakou dobu trénink. Odkaz na Google Co je také dáno.

Metoda 2: Použití knihovny datových sad

V této metodě předvedeme implementaci potrubí pomocí knihovny „datasets“:

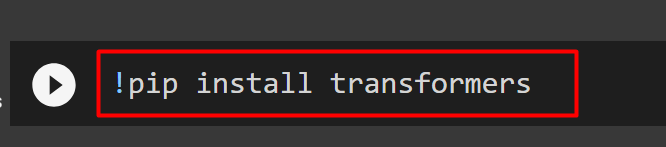

Krok 1: Nainstalujte Transformer

Chcete-li nainstalovat knihovnu Transformer, zadejte následující příkaz:

!pip instalujte transformátory

Krok 2: Nainstalujte knihovnu datových sad

Jako „ datové sady ” knihovna obsahuje všechny veřejné datové sady, můžeme ji nainstalovat pomocí následujícího příkazu. Instalací „ datové sady ” knihovny, můžeme přímo importovat libovolnou datovou sadu zadáním jejího názvu:

!pip instalační datové sady

Krok 3: Potrubí datové sady

Chcete-li vytvořit kanál na datové sadě, použijte následující kód. KeyDataset je funkce, která vydává pouze ty hodnoty, které uživatele zajímají:

z transformers.pipelines.pt_utils import KeyDatasetz transformátorů import potrubí

z datových sad importovat load_dataset

gen_pipeline = pipeline(model='hf-internal-testing/tiny-random-wav2vec2', device=0)

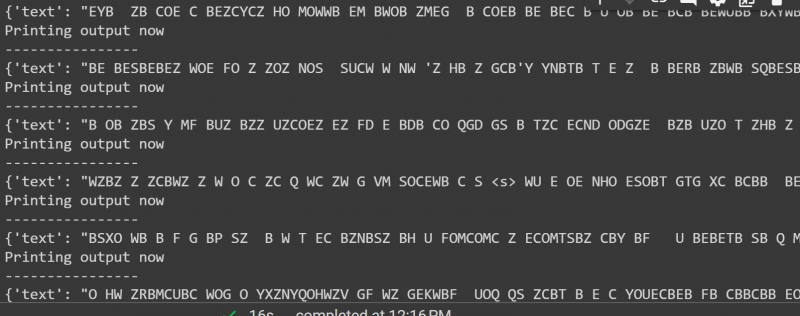

loaddataset = load_dataset('hf-internal-testing/librispeech_asr_dummy', 'clean', split='validation[:10]') pro výstup v gen_pipeline(KeyDataset(loaddataset, 'audio')):

print('Tisk výstupu nyní')

tisk ('----------------')

tisk (výstup)

Výstup výše uvedeného kódu je uveden níže:

To je z tohoto průvodce vše. Odkaz na Google Co je také zmíněn v tomto článku

Závěr

Chcete-li použít kanály na datovou sadu, můžeme buď iterovat datovou sadu pomocí funkce pipeline() nebo použít „ datové sady “knihovna. Hugging Face poskytuje svým uživatelům odkaz na úložiště GitHub pro datové sady i modely, které lze použít na základě požadavků. Tento článek poskytuje komplexního průvodce aplikací potrubí na datovou sadu v Transformers.