Tento příspěvek ilustruje metodu použití funkcí a tříd výstupního analyzátoru prostřednictvím rámce LangChain.

Jak používat výstupní analyzátor přes LangChain?

Výstupní analyzátory jsou výstupy a třídy, které mohou pomoci získat strukturovaný výstup z modelu. Chcete-li se naučit proces používání výstupních analyzátorů v LangChain, jednoduše projděte uvedenými kroky:

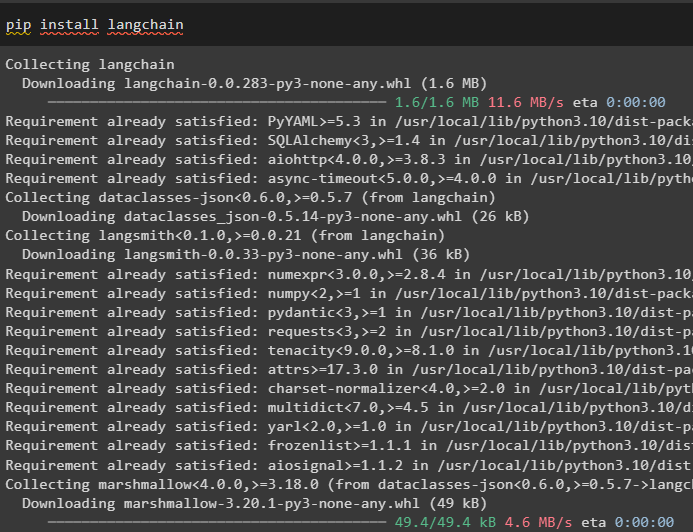

Krok 1: Nainstalujte moduly

Nejprve spusťte proces používání výstupních analyzátorů instalací modulu LangChain s jeho závislostmi, abyste proces prošli:

pip Nainstalujte langchain

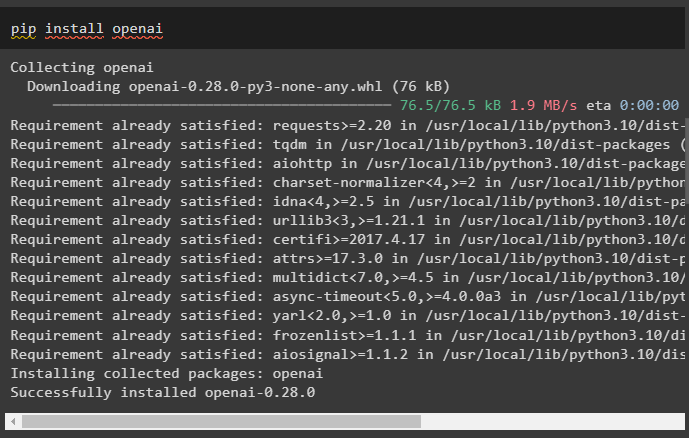

Poté nainstalujte modul OpenAI, abyste mohli používat jeho knihovny jako OpenAI a ChatOpenAI:

pip Nainstalujte openai

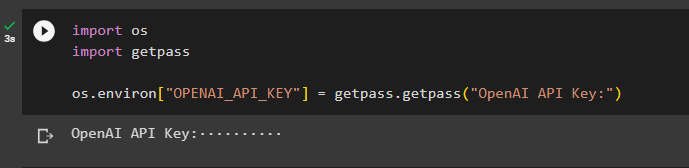

Nyní nastavte prostředí pro OpenAI pomocí klíče API z účtu OpenAI:

importujte nás

importovat getpass

os.environ [ 'OPENAI_API_KEY' ] = getpass.getpass ( 'Klíč OpenAI API:' )

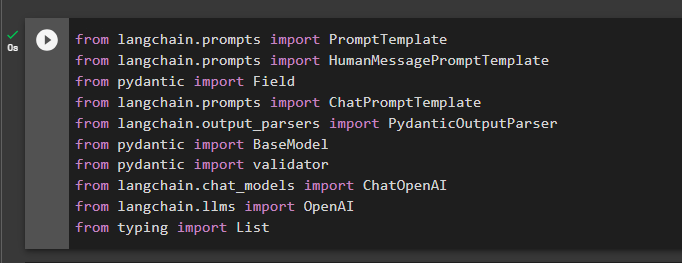

Krok 2: Import knihoven

Dalším krokem je import knihoven z LangChain pro použití výstupních analyzátorů v rámci:

from langchain.prompts import HumanMessagePromptTemplate

z pydantického importního pole

z langchain.prompts importujte ChatPromptTemplate

z langchain.output_parsers importujte PydanticOutputParser

z pydantického importu BaseModel

z pydantického validátoru importu

z langchain.chat_models importujte ChatOpenAI

z langchain.llms importujte OpenAI

zadáním seznamu importu

Krok 3: Vytvoření datové struktury

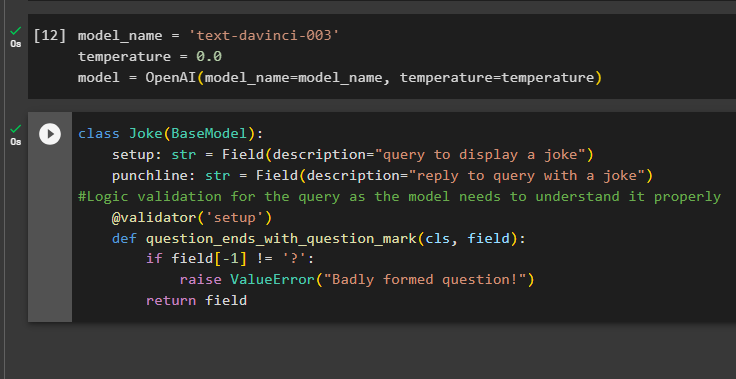

Vytvoření struktury výstupu je zásadní aplikací výstupních analyzátorů ve velkých jazykových modelech. Než se dostaneme k datové struktuře modelů, je nutné definovat název modelu, který používáme k získání strukturovaného výstupu z výstupních parserů:

teplota = 0,0

model = OpenAI ( jméno modelu =název_modelu, teplota = teplota )

Nyní použijte třídu Joke obsahující BaseModel ke konfiguraci struktury výstupu, abyste získali vtip z modelu. Poté může uživatel snadno přidat vlastní logiku ověření pomocí třídy pydantic, která může požádat uživatele, aby vložil lépe vytvořený dotaz/výzvu:

třídní vtip ( Základní Model ) :nastavení: str = pole ( popis = 'dotaz pro zobrazení vtipu' )

punchline: str = Pole ( popis = 'odpovědět na dotaz vtipem' )

#Logické ověření pro dotaz, protože model mu musí správně porozumět

@ validátor ( 'založit' )

def question_ends_with_question_mark ( cls, pole ) :

-li pole [ - 1 ] ! = '?' :

zvýšit ValueError ( 'Špatně položená otázka!' )

vrátit se pole

Krok 4: Nastavení šablony výzvy

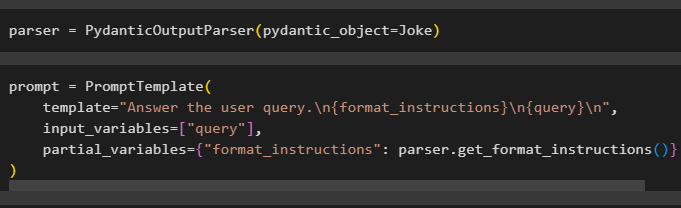

Nakonfigurujte proměnnou analyzátoru obsahující metodu PydaticOutputParser() obsahující její parametry:

Po konfiguraci analyzátoru jednoduše definujte proměnnou výzvy pomocí metody PromptTemplate() se strukturou dotazu/výzvy:

prompt = PromptTemplate (šablona = 'Odpovězte na dotaz uživatele. \n {format_instructions} \n {dotaz} \n ' ,

vstupní_proměnné = [ 'dotaz' ] ,

částečné_proměnné = { 'format_instructions' : parser.get_format_instructions ( ) }

)

Krok 5: Otestujte výstupní analyzátor

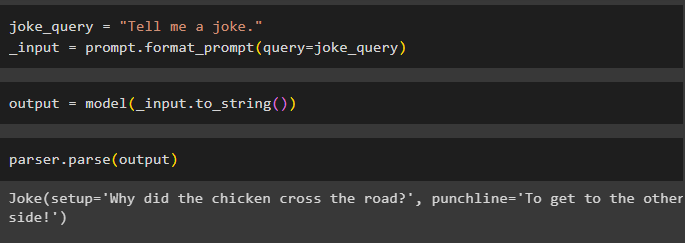

Po konfiguraci všech požadavků vytvořte proměnnou, která je přiřazena pomocí dotazu, a poté zavolejte metodu format_prompt():

_input = prompt.format_prompt ( dotaz =dotaz_vtipu )

Nyní zavolejte funkci model() k definování výstupní proměnné:

výstup = model ( _input.to_string ( ) )Dokončete proces testování voláním metody parser() s výstupní proměnnou jako jejím parametrem:

parser.parse ( výstup )

To je vše o procesu použití výstupního analyzátoru v LangChain.

Závěr

Chcete-li použít výstupní analyzátor v LangChain, nainstalujte moduly a nastavte prostředí OpenAI pomocí jeho klíče API. Poté definujte model a poté nakonfigurujte datovou strukturu výstupu s logickou validací dotazu poskytnutého uživatelem. Jakmile je datová struktura nakonfigurována, jednoduše nastavte šablonu výzvy a poté otestujte výstupní analyzátor, abyste získali výsledek z modelu. Tato příručka ilustruje proces použití výstupního analyzátoru v rámci LangChain.