V této éře jsou transformátory nejvýkonnějšími modely, které poskytují nejlepší výsledky ve více operacích NLP (zpracování přirozeného jazyka). Zpočátku se používal pro úlohy jazykového modelování včetně generování textu, klasifikace, strojového překladu a mnoha dalších. Nyní se však používá také pro rozpoznávání objektů, klasifikaci obrázků a mnoho dalších úloh počítačového vidění.

V tomto tutoriálu poskytneme postup pro provádění klasifikace textu pomocí Transformers.

Jak provést klasifikaci textu pomocí transformátorů?

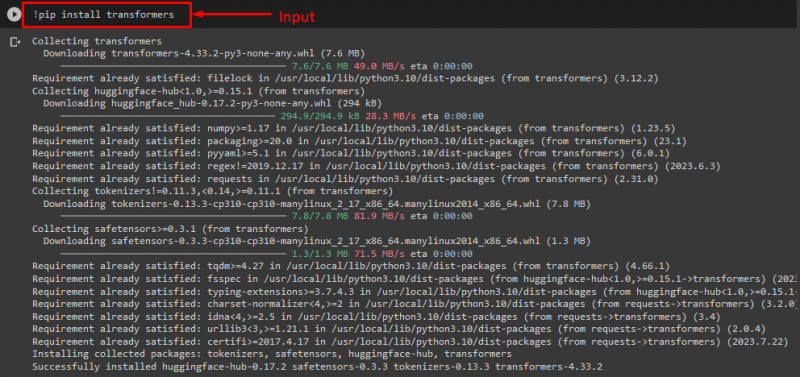

Chcete-li provést klasifikaci textu pomocí Transformers, nejprve nainstalujte „ transformátory ” knihovny provedením poskytnutého příkazu:

! pip Nainstalujte transformátory

Jak vidíte, zadaná knihovna byla úspěšně nainstalována:

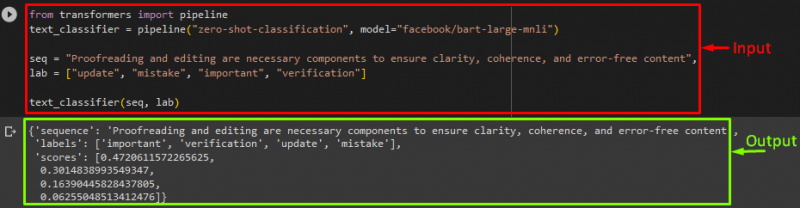

Poté importujte „ potrubí “ z „ transformátory ”knihovna:

z transformátorů import potrubí

Zde, „ potrubí bude obsahovat úlohu NLP, kterou musíme provést, a požadovaný model transformátoru pro tuto operaci spolu s tokenizerem.

Poznámka: Tokenizer se používá ke zpracování textu, který má být poskytnut jako vstup modelu, rozdělením textu do tokenů.

Poté použijte „ potrubí() “ a předejte jí “ zero-shot-klasifikace “ jako argument. Dále předejte další parametr, kterým je náš model. Používáme Facebook „ BART “model transformátoru. Zde nepoužíváme tokenizer, protože jej lze automaticky odvodit ze zadaného modelu:

text_classifier = potrubí ( 'klasifikace nulového výstřelu' , Modelka = 'facebook/bart-large-mnli' )

Nyní deklarujte „ seq ” proměnná, která obsahuje náš vstupní text, který je třeba klasifikovat. Poté poskytneme kategorie, do kterých chceme text zařadit a uložit do „ laboratoř “, který je známý jako štítky:

laboratoř = [ 'Aktualizace' , 'chyba' , 'Důležité' , 'ověření' ]

Nakonec spusťte potrubí spolu se vstupem:

Po provedení pipeline, jak můžete vidět, model předpověděl, že námi poskytnutá sekvence bude klasifikována:

Dodatečné informace: Pokud chcete urychlit výkon modelu, musíte použít GPU. Pokud ano, pak pro tento účel můžete zadat argument zařízení do kanálu a nastavit jej na „ 0 ” pro využití GPU.

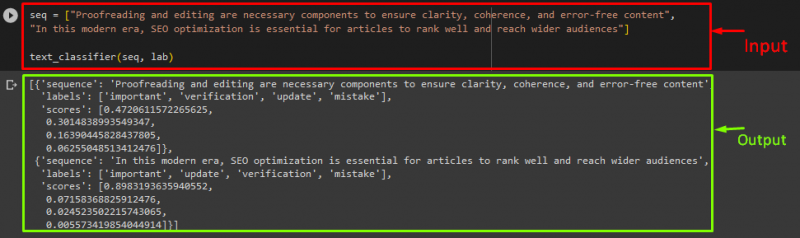

Pokud chcete klasifikovat text ve více než jedné sekvenci/vstupním textovém příkazu, můžete je přidat do seznamu a předat jej jako vstup do kanálů. Pro tento účel se podívejte na fragment kódu:

seq = [ „Korektury a úpravy jsou nezbytné součásti k zajištění srozumitelnosti, soudržnosti a bezchybného obsahu“ ,„V této moderní době je SEO optimalizace nezbytná pro to, aby se články dobře hodnotily a oslovily širší publikum.“ ]

textový_klasifikátor ( seq , laboratoř )

Výstup

A je to! Sestavili jsme nejjednodušší způsob, jak provést klasifikaci textu pomocí Transformers.

Závěr

Transformátory se používají k provádění úloh jazykového modelování, jako je generování textu, klasifikace textu a strojový překlad, stejně jako úlohy počítačového vidění, včetně rozpoznávání objektů a klasifikace obrázků. V tomto tutoriálu jsme ilustrovali proces provádění klasifikace textu pomocí Transformers.